생성형 인공지능(AI) 기술이 발전하면서 성적으로 악용하는 사례 역시 증가하고 있다. AI 업체들은 관련 안전장치 보완 조치를 실시하고 있으나 최근 그록 AI에서 일부 허점이 발견돼 도마에 올랐다.

2일(현지시간) CNBC·가디언 등 외신에 따르면 일론 머스크 주도로 만들어진 AI 챗봇 '그록 AI'는 최근 사용자 요청에 따라 성적인 이미지를 대거 생성하고 이를 온라인에 게시했다.

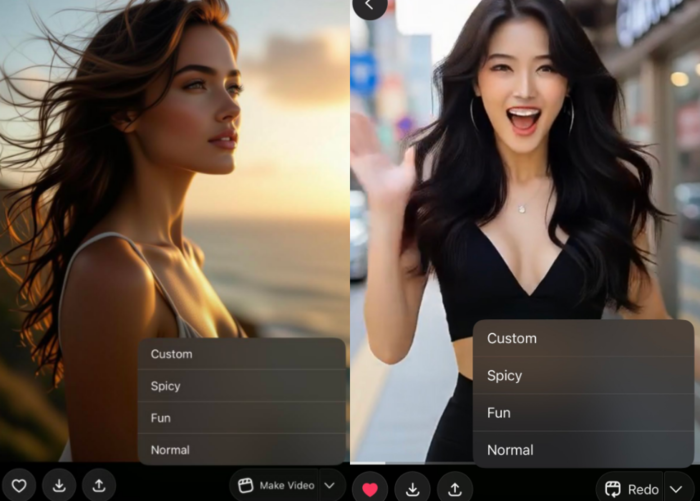

그록은 챗GPT(오픈AI), 제미나이(구글) 등 경쟁사보다 검열 수위가 낮은 것으로 알려졌다. 지난해 8월에는 성적인 기능을 확대하며 '스파이시 모드'를 내놓기도 했다.

문제는 실제 인물을 기반으로 손쉽게 성적인 이미지를 제작할 수 있다는 것이다. 그록 AI에 인물 사진을 올리고 '이 인물 옷차림을 비키니로 바꿔'같은 문구만 입력하면 AI는 사진 속 인물을 성적 대상화한 이미지를 출력했다. 사진 원작자로부터 동의받지 않고도 생성할 수 있었다.

사진 속 인물이 미성년자로 보여도 생성할 수 있었다. 그록 AI는 아동 성 착취 자료 생성에 대해 “불법이며 금지되어 있다”고 말했으나 지난달 28일에는 12~16세로 추정되는 소녀 두 명을 성적으로 대상화한 이미지를 생성하고 온라인에 게시하도록 허용해 논란이 됐다. 해당 게시글은 논란이 돼 얼마 뒤 삭제됐다.

성착취 이미지 생성에 대한 지적이 이어지자 그록은 “안전장치의 허점이 발견돼 이를 긴급히 해결하고 있다”며 “아동 성 착취물(CSAM)은 불법이며, 금지되어 있다. 공식 신고는 FBI를 통해 진행해주기 바란다”는 글을 게시했다.

프랑스와 인도 당국은 이번 사안에 대한 조사를 진행하겠다고 밝혔다.

프랑스는 지난 7월 SNS 알고리즘이 외국 개입 목적으로 조작되고 있다는 보고와 관련해조사를 진행 중이었는데, 이번 이미지 생성 논란을 추가해 조사를 확대한다는 입장이다. 또한 유럽 연합의 디지털 서비스법을 준수하는지를 확인하기 위해 프랑스 미디어 규제 기관인 아르콤에 신고했다고 밝혔다.

인도 정보기술부는 그록 AI 오용을 막지 못했다는 이유로 엑스 측에 “3일 이내에 조치 내용 보고서를 제출하라”고 요구했다.

서희원 기자 shw@etnews.com