인텔이 네이버와 운용 비용을 절감할 수 있는 인공지능(AI) 서버를 구축했다. 고가의 그래픽처리장치(GPU)를 중앙처리장치(CPU)로 대체하는 방식으로, 연간 4억원 규모 비용을 아끼는 데 성공했다. 높은 비용 때문에 AI 인프라 조성에 부담을 가지는 데이터센터와 클라우드 서비스 사업자에 새로운 방법론을 제시한 것으로 평가된다.

인텔은 최근 네이버와 '네이버 플레이스' 서비스의 AI 모델 서버를 전환하고 모델 최적화에 성공했다고 30일 밝혔다. 인텔 CPU와 소프트웨어 솔루션을 적용, 성능 저하나 추가 비용 없이 AI 서비스를 구현한 것이 특징이다.

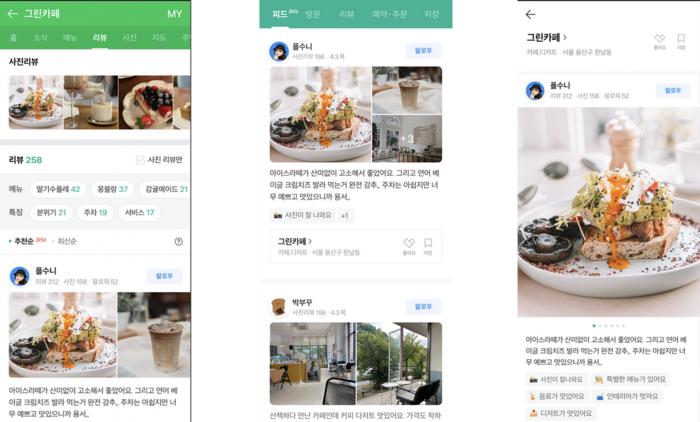

네이버 플레이스는 다양한 오프라인 상점의 상세 정보를 검색하고 확인할 수 있는 대표적 O2O(온·오프라인 연계) 서비스다. 상점 이용자들이 입력한 각종 정보를 실시간으로 수집 및 활용, 정보 진위 여부를 평가하는데 AI 모델을 활용한다.

네비어 플레이스 AI 모델은 AI 추론을 위한 각종 전처리와 추론 결과 후처리에 CPU가, 추론 과정 자체는 GPU가 담당하는 방식이었다. 그러나 GPU 기반 서버 비용 증가과 가용성 제한으로 인텔과 새로운 방식의 AI 서버 구축 전략을 모색했다. AI용 GPU가 대부분 고가라 서비스 사업자에 부담이다.

인텔과 네이버는 기존 GPU를 2세대 인텔 제온프로세서(CPU)로 대체했다. 또 신경망 추론(NNI)에 최적화된 인텔 소프트웨어 솔루션(파이토치 확장팩)을 적용, AI 모델을 개선했다. 단순 GPU를 CPU로 바꿀 경우 성능 저하가 예상되는 만큼 네이버 플레이스 서비스에 최적화된 AI 모델을 확보한 것이다.

그 결과 서버의 초당 데이터 처리 개수(RPS)를 최대 7배 개선하게 됐다. 실제 서비스에서는 음식사진 분류 33배, 이미지 점수 측정 30배, 영수증 분류 5.5배 성능 개선을 이뤄냈다. 양사는 최종 테스트를 위해 한 달 간 사전 검증 후 현재 실제 서비스에 적용, 운용 중이다. 한국 및 일본에서 각 15대 GPU 기반 서버 사용을 줄여 연간 약 4억원 이상 운용 비용을 절감했다.

이번 네이버 사례는 서비스에 맞춰 고가 GPU 없이 CPU로 AI 모델을 최적화할 수 있다는 것을 입증했다. AI 서비스용 인프라 구축 및 운용 비용을 효율화할 수 있는 계기가 될 것으로 예상된다.

양사는 현재 4세대 인텔 제온 스케일러블 프로세서와 어드밴스드 매트릭스 익스텐션(AMX)을 활용한 테스트를 진행 중이다. 향후 최신 CPU 도입에 따른 추가적 성능 향상을 기대했다.

주윤상 네이버G플레이스 AI개발 팀장은 “성능 하락 없이 이전과 동일한 서비스 품질을 유지하면서 GPU 모델 서버의 CPU전환과 AI모델 최적화로 운영 비용을 절감할 수 있었다”며 “이를 통해 현재 서비스에 적용할 비용 효율적인 AI서비스 운영 방안 마련은 물론, 향후 확대 적용할 수 있는 기술 기반을 확보했다”고 말했다.

나승주 인텔코리아 상무는 “AI는 GPU라는 고정관념에서 벗어나, 총소유비용을 최적화할수 있는 시스템과 인프라를 구축해야한다”며 “AI 모델 개발 및 배포, 데이터 전·후처리를 포함하는 전체 과정을 면밀히 검토하고, CPU를 효율적으로 활용하면 GPU 사용을 최소화하면서도 원하는 성능을 확보할 수 있다”고 밝혔다.

권동준 기자 djkwon@etnews.com