사람에게 일을 맡길 때 '미심쩍다면 아예 쓰지 말고, 일단 쓰기로 마음먹었다면 믿고 확실히 맡겨라'라는 말이 종종 쓰이곤 한다. 이는 누군가를 대신해 일을 수행해 줄 사람, 즉 에이전트에게 권한을 위임하는 과정에서 신뢰 관계를 기반으로 의사결정을 해야 한다는 의미다. 단순한 권한 위임(Delegation)을 넘어 확실한 권한 부여, 즉 파워 임파워먼트(Power Empowerment)가 필요하다는 뜻이기도 하다.

그렇다면 이 말이 인공지능(AI) 에이전트에게도 그대로 적용될 수 있을까.

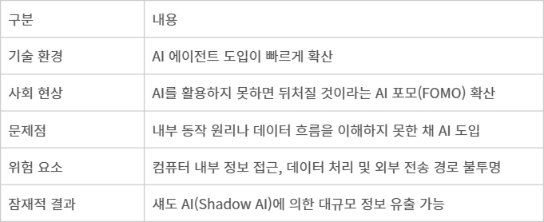

최근 개인들은 AI 기술 습득과 활용을 서두르지 않으면, 단순히 지식 경쟁에서 뒤처지는 것을 넘어 조직 내 생존 문제로까지 이어질 수 있다는 불안감에 휩싸여 있다. 이른바 AI 포모(FOMO) 현상이다.

여러 매체에서는 최신 AI 에이전트를 도입해 조직의 업무 효율을 100배에서 1000배 이상 높였다는 사례를 소개한다. 동시에 이러한 기술을 빠르게 수용하지 못하면 도태될 것이라는 경고도 이어진다. 조직뿐 아니라 개인 역시 가까운 미래에 다가올 '핵개인화 시대'에서 우수한 AI 에이전트를 활용하지 못하면, 이를 능숙하게 활용하는 사람과의 격차가 크게 벌어질 것이라는 전망도 나온다.

그러나 우리는 지금 AI의 내부 동작 원리조차 충분히 이해하지 못한 상태에서 도입부터 서두르고 있는 것은 아닌지 돌아볼 필요가 있다. 내가 사용하는 컴퓨터 안의 어떤 정보를 읽어들이는지, 읽어들인 정보를 어떻게 처리하는지, 처리된 정보가 어디로 전송되는지조차 모른 채 일단 설치부터 하고 있는 상황은 아닌지 점검해야 한다.

충분한 검증(Verification)이 이뤄지지 않았음에도 모든 자원을 선뜻 내어주고 '일단 맡겼으니 믿어보자. 결과만 좋으면 되는 것 아닌가'라는 식으로 효율만을 추구하다 보면, 나도 모르는 사이에 섀도 AI에 의해 대규모 정보 유출 사고가 발생할 수도 있다.

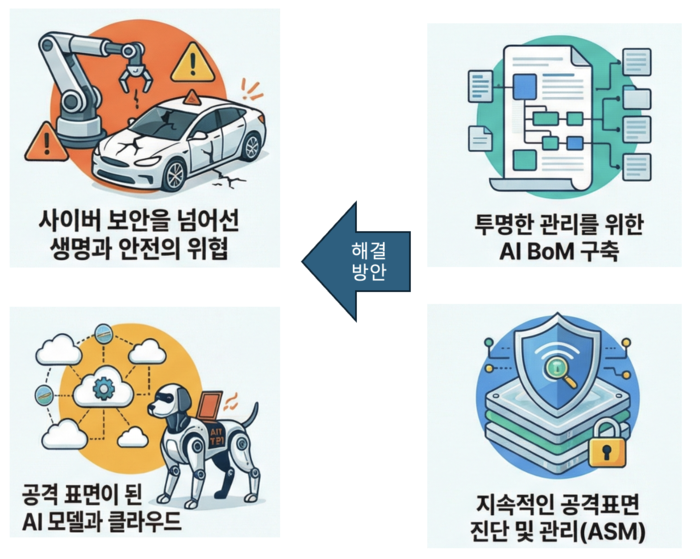

문제는 이러한 위험이 단순히 사이버 공간에만 머물지 않는다는 점이다. 이제는 피지컬 AI의 시대가 도래했다. 사이버 공격이 물리적 실체를 가진 로봇, 자율주행차, 스마트 팩토리로까지 이어질 수 있는 환경이 만들어졌다. AI가 탑재돼 있거나 외부 AI 서비스를 호출해 사용하는 모든 사물이 공격 대상이 될 수 있다. 이는 단순한 보안 문제를 넘어 안전과 생명까지 위협할 수 있는 문제다.

로봇이라고 하면 아직도 공상과학 소설 속 이야기처럼 느껴질 수 있다. 그러나 현실은 다르다. 로봇 개의 경우 과거에는 폭발물 처리용 로봇처럼 군이나 경찰 등 특수 목적의 기관에서 제한적으로 사용됐다. 하지만 지금은 오픈소스 기반 로봇이 등장했고 가정용 로봇 개도 상용화돼 활발히 판매되고 있다.

실제로 시중에 판매 중인 로봇 개에서 백도어가 발견됐거나, 펌웨어 해킹을 통해 원격에서 제어권을 탈취한 사례도 보고된 바 있다. 로봇에 탑재된 AI 모델 자체뿐 아니라, AI가 연결되는 외부 클라우드, 호출되는 AI 서비스 응용프로그램 인터페이스(API) 등 모든 경로가 공격 표면이 됐다. 그리고 이러한 위협은 이미 현실로 가다왔다.

이러한 문제에 대응하기 위한 방법은 크게 두 가지다.

첫째는 AI 및 피지컬 AI이 탑재된 모든 사물에 대해 공격 표면 관리(ASM)를 지속적으로 수행하는 것이다. 이를 통해 취약점을 지속적으로 식별하고 테스트하며, 설계 단계에서 미처 예상하지 못했던 보안 취약점을 발견하고 해결해 나가야 한다.

둘째는 AI 공급망 관리를 철저히 하는 것이다. AI 모델은 기본적으로 블랙박스와 유사한 구조를 가지고 있다. 따라서 우리가 사용하기로 한 AI의 실제 구성과 출처를 정확히 파악하기 어렵다.

우리는 시장에서 식재료를 구매할 때조차 유해 성분이 없는지 꼼꼼히 확인한다. 또 위생 감독 기관은 유통 과정에서 상품이 변질될 가능성이 없는지 콜드체인(Cold Chain)을 확인한다.

마찬가지로 로봇 등 사물에 탑재되는 AI에도 명세서가 필요하다. 이를 AI 구성 명세서, 즉 AI BoM(Bill of Materials)이라고 부른다. 이 명세서를 통해 사용된 라이브러리에 취약점이 없는지, 신뢰할 수 있는 공급자로부터 제공된 것인지 등을 검증해야 한다.

이러한 AI BoM 체계를 구축하면, 데이터가 학습 과정에서 오염되지 않았는지, 사용된 모델 자체에 보안 결함은 없는지, 취약점이 존재하는 버전의 오픈소스 모델이 사용되지는 않았는지 점검할 수 있다. 외부 AI 모델이나 응용프로그램 인터페이스(API)와 연결되는 과정에서 데이터가 위·변조되거나 유출될 가능성도 함께 확인할 수 있다.

요컨데, AI BoM 검증 체계를 구축하고 지속적으로 관리해야만 AI 서비스의 전체 동작 과정을 투명하게 모니터링할 수 있도록 해야 한다.

지금은 국가의 향후 20년 먹거리를 준비해야 하는 중요한 시점이다. 기술 수용 속도가 국가 경쟁력을 좌우하는 시기라는 점도 부인할 수 없다. 그러나 최근 발생한 오픈클로의 보안 문제 사례에서 보듯, 최소한의 검증도 없이 효율만을 추구한다면 과거 안전불감증으로 인해 오랜 세월 우리가 치렀던 대가를 다시 치르게 될 가능성이 있다. 단, 이번에는 그 대가가 정보기술 인프라와 피지컬 AI이 적용된 일상생활 전반에서 나타날 수 있다.

따라서 설계 단계부터 보안을 고려하는 '시큐어 바이 디자인(Secure by Design)' 접근이 필요하다. 또 AI 서비스 영역까지 ASM 활동을 확대하고, 취약점 공개 프로그램(VDP)과 협력적 취약점 공개(CVD) 등 취약점 발굴 체계를 적극 활용해 대응해야 한다.

그렇지 않다면 머지않아 '열 길 물속은 알아도 한 길 사람 속은 모른다'는 속담이 '열 길 사람 속은 알아도 한 길 AI 속은 모른다'는 말로 바뀌는 장면을 목도하게 될 것이다.

김휘강 고려대 정보보호대학원 교수 cenda@korea.ac.kr

〈필자〉한국과학기술원(KAIST) 재학 시절 해커로 활동하며 다수의 기관과 기업들에 모의해킹과 컨설팅을 수행한 경험을 바탕으로 1999년 국내 최초의 보안 컨설팅 전문업체인 에이쓰리시큐리티를 창업했다. 2004년부터 엔씨소프트에서 정보보안실장으로 본사, 지사 및 합작사(JV) 보안업무를 수행했다. 2010년부터 고려대 교수로 재직 중이며 스마트보안학부 학부장을 맡고 있다. 사이버위협정보(CTI)와 ASM의 중요성을 알리고 있으며 현재 개인정보보호위원회 위원이다.